Čísla z curlu ukazují rozpad poměru signálu a šumu

Co se dozvíte v článku

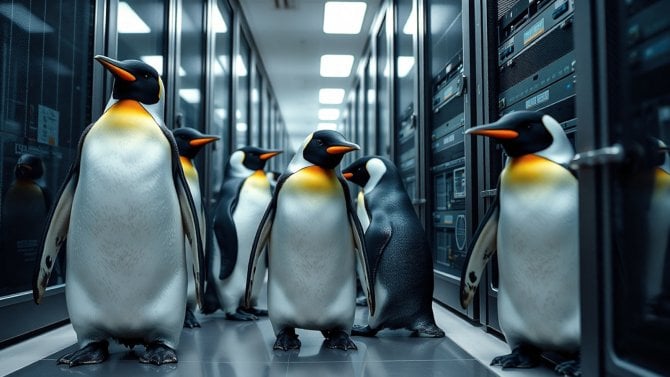

Projekt curl provozoval bug bounty od dubna 2019. Za necelých sedm let program vyplatil přes sto tisíc dolarů a potvrdil 87 reálných zranitelností. Podle Stenbergova oznámení byl poměr potvrzených hlášení zhruba do roku 2024 přes patnáct procent, v roce 2025 spadl pod pět. V blogu Death by a thousand slops z července 2025 Stenberg doplnil, že zjevně chybné reporty AI v roce 2025 tvořily přibližně pětinu všech oznámení.

Ve své zprávě z 26. ledna 2026 formuluje důvod bez vytáček. Program na odměňování za hlášení chyb v curlu již není. Oficiálně končí 31. ledna 2026,

píše v úvodu textu. Dál nevyhýbavě pojmenovává problém: Není v naší moci změnit, jak všichni tihle lidé a jejich stroje na odpad fungují. Musíme udělat kroky, abychom zajistili přežití a nedotčené duševní zdraví.

Zajímavý kontext přinesla statistika, kterou curlu poskytl sám HackerOne. Curl měl v posledních čtyřech kvartálech prudce rostoucí objem příchozích hlášení, zatímco srovnatelné open-source programy jako Ruby, Node nebo Rails zůstaly na stejné úrovni nebo mírně klesaly. Stenberg si to vysvětluje tím, že curl byl atraktivnější cíl kvůli vyšším odměnám a viditelnosti. Po zrušení bounty toku hlášení skutečně výrazně opadl, což dobře doložil jeho následný post z konce února 2026 .

Drobná poznámka k chronologii: curl nejprve přesunul reporting na GitHub, ale v březnu se vrátil zpět na HackerOne, tentokrát bez finanční odměny. Odměny jsou pryč, platforma zůstává.

Anatomie slop reportu

Hlášení generovaná jazykovými modely mají společné rysy, které Stenberg i další správci popisují shodně. Formálně působí profesionálně, obsahují odkazy na CVE, názvy funkcí, čísla řádků, ukázky „problematického" kódu. Po ověření se často ukáže, že odkazované CVE se zranitelnosti netýká, funkce v projektu neexistuje nebo popsaný mechanismus chyby nemá s žádnou vazbu na skutečný kód.

Daniel Stenberg v dřívějším textu popsal konkrétní případ. Hlášení nazvané „Buffer Overflow Vulnerability in WebSocket Handling" působilo na první pohled kvalitně, mělo strukturovaný popis, reprodukční kroky i vysvětlení dopadu. Při ověření se ukázalo, že žádný z popsaných jevů v kódu nenastává. Další komunikace podle Stenberga nepřinesla žádné ověřitelné upřesnění a pouze zvyšovala náklady na ruční ověření a třídění.

Obdobnou zkušenost zdokumentoval Seth Larson, který ověřování dělá mimo jiné pro CPython, pip, urllib3 a Requests. Ve svém textu New era of slop security reports for open source z prosince 2024 uvedl konkrétní příklad: urllib3 dostalo hlášení o chybě v podpoře SSLv2, přestože knihovna SSLv2 explicitně zakazuje. Report vznikl tak, že automatický skener prostě identifikoval výskyt řetězce v kódu a model na tom postavil popis „zranitelnosti".

V jiném textu Larson popisuje další rovinu problému: automatizované veřejné zostouzení správců, kdy jsou tato falešná hlášení sdílena vedle platforem i na sociálních sítích a uživatelé pak tlačí projekt k opravě neexistujícího problému.

HackerOne pozastavil IBB, Node.js přišel o zdroj odměn

HackerOne oznámil 27. března 2026 pozastavení přijímání nových hlášení v rámci Internet Bug Bounty (IBB), programu pro open source, který od roku 2012 vyplatil přes 1,54 milionu dolarů. V oficiálním vyjádření platformy zazněla formulace, která problém shrnuje přesně: Rovnováha mezi nálezy a kapacitou na opravu v open source se zásadně posunula.

Podle dřívějšího dělení šlo zhruba 80 procent výplat na objevování nových chyb a 20 procent na podporu nápravy problémů. Právě tuto proporci AI podle HackerOne rozbila. John Morello, spoluzakladatel společnosti Minimus, to v komentáři pro Dark Reading popsal tak, že podíl validních hlášení spadl přibližně z patnácti procent pod pět. HackerOne vlastní číselnou metriku nezveřejnil, ale Morellův odhad odpovídá trendu, který hlásí curl i další projekty.

Na pauzu IBB navázal Node.js, ale důvod byl trochu jiný, než jak ho zkratkovitě popisují sekundární zdroje. Node.js v oficiálním oznámení výslovně uvádí, že jeho bounty program byl od roku 2016 financován právě z IBB. Projekt sám rozpočet na odměny nemá: Jako open-source projekt poháněný dobrovolníky nemá Node.js nezávislý rozpočet, který by udržel bounty program samostatně.

Sběr a posuzování hlášení přes HackerOne pokračuje, odměny nikoli.

Do stejné linie patří i tichý krok Googlu, který přibližně ve stejné době přestal přijímat generovaná hlášení od AI do svého Open Source Software Vulnerability Reward Programu. Tři různé reakce, jedna společná pružina.

Asymetrie, kterou AI rozbila

Bug bounty jako institut stál na nepsaném předpokladu, že vytvoření věrohodného reportu je poměrně drahé. Vyžadovalo to čas na porozumění kódu, energii na ověření hypotézy a rozsáhlé penzum znalostí. Tato cena tvořila přirozený filtr kvality a držela poměr signálu k šumu na úrovni, kterou malý tým správců zvládal.

Generativní modely tento filtr odstranily na straně odesílatele, ale nedotkly se ceny ověření na straně projektu. Správce musí report pořád přečíst, podívat se do kódu, ověřit tvrzení, formulovat odpověď. I když je to pět minut na jeden automatizovaný nesmysl, při desítkách hlášení týdně jde o citelnou zátěž.

Ekonomicky je to pro útočníka nebo oportunistu zajímavé. Tisíce dotazů do levného modelu stojí zlomek výplaty z jednoho úspěšného reportu. Konkrétní návratnost neumím spočítat bez interních dat z platforem a nebudu ji odhadovat, ale logika asymetrie je zřejmá: generování je levné, ověření není. Dokud tato asymetrie existuje, otevřený komunikační kanál s peněžní odměnou je prostě neudržitelný.

Nakonec je to takový DDoS na proces ověřování hlášení chyb. Ne technický, ale sociální a kognitivní. Dobrovolník, který třeba večer po práci udržuje knihovnu používanou v polovině internetu, se časem rozhodne, že tohle dělat nebude.

12,5 milionu dolarů na problém, který peníze samy neřeší

Linux Foundation, iniciativa Alpha-Omega a OpenSSF

ohlásily

17. března 2026 grant ve výši 12,5 milionu dolarů na podporu správců přetížených automatizovanými hlášeními. Mezi přispěvateli jsou Anthropic, AWS, GitHub, Google, Google DeepMind, Microsoft a OpenAI. Firmy, které samy generativní AI vyvíjejí a komerčně nasazují.Komentář Grega Kroah-Hartmana stojí za pozornost právě proto, že zazněl zároveň s oznámením: Samotné grantové financování nevyřeší problém, který nástroje AI dnes způsobují bezpečnostním týmům v open source.

Formálně je to přiznání, že peníze bez strukturálního řešení situace jen prodlouží. Peníze mají jít primárně na nástroje pro třídění hlášení a expertizu správců projektů, ne na další odměny.

Platformy na problém reagují vlastními nástroji založenými na AI. HackerOne spustil Hai Triage, službu kombinující automatizovanou filtraci s lidskou validací. Bugcrowd přidal AI Triage Assistant a aktualizoval pravidla proti „sloptimism". Obojí znamená, že proti AI slopu se staví další vrstva AI. Funkční odpověď, ale taková, která problém posouvá o úroveň výš. Pokud schopnosti generátoru hlášení časem doženou ověřující filtr, budeme zpátky na začátku.

Čistší a dlouhodobá cesta by vedla přes přenesení nákladu na odesílatele. Povinné reprodukční prostředí, technická kauce vracená po validaci, silnější reputační systém s tvrdším trestem za AI slop. Některé projekty už tímto směrem opatrně jdou, curl sám mluvil o blokování opakovaných autorů nesmyslných automatických hlášení.

Druhá strana: kde AI skutečně funguje

Stejné modely, které produkují chybné reporty, zároveň nacházejí reálné zranitelnosti. Google ve spolupráci s OSS-Fuzz a vlastními modely (OSS-Fuzz-Gen) ohlásil mimo jiné nález CVE-2024–9143 v OpenSSL, chyby, která v kódu pobývala dlouhou dobu. Anthropic v roce 2026 použil Claude Opus 4.6 na dvoutýdenní prověření Firefoxu a ohlásil 22 dříve neznámých zranitelností, z toho čtrnáct označených za velmi závažné.

Mozilla nálezy potvrdila. OpenAI na svůj produkt Codex Security, vyvinutý z dřívějšího projektu Aardvark, uvádí, že za třicet dnů bety proskenoval přes 1,2 milionu commitů a identifikoval 792 kritických a 10 561 vysoce závažných nálezů. Míra falešné pozitivity podle OpenAI klesla napříč repozitáři o více než padesát procent, šum o 84 procent. Číslo „pod deset procent", které někdy kolují, v oficiálních materiálech není.

Rozdíl mezi těmito projekty a slop potopou není v modelu. Je v tom, co se kolem modelu postaví. Sandbox na validaci zranitelnosti, threat model repozitáře, symbolická analýza, fuzzery, lidská validace před odesláním hlášení. Slop je model bez okolního inženýrství. Reálný nález využívá model jako jednu komponentu v disciplinovaném procesu.

Kam to směřuje

Bug bounty je v současné podobě pod tlakem, který se sám od sebe neuvolní. Buď se zavedou tvrdší bariéry vstupu, nebo se další programy budou zavírat. Třetí scénář, postupná segregace, už pravděpodobně běží. Velké projekty s rozpočtem přecházejí na hybridní modely, kde AI třídič hlášení předchází lidské kontrole. Malé projekty typu curl svůj bounty program zrušily a vrátily se k tomu, že zranitelnost nahlásíte přes privátní kanál bez nároku na odměnu.

Asymetrie mezi náklady na vytvoření špatného reportu a náklady na jeho ověření se s dalšími generacemi modelů bude pravděpodobně prohlubovat, ne vyrovnávat. Projekty, které si to přiznají brzy, mají šanci zachovat smysluplný kanál pro reálná bezpečnostní hlášení. Daniel Stenberg o tom přednášel na konferenci FOSDEM 2026 pod titulkem Open Source Security in spite of AI a stojí za to si to poslechnout, protože jde o jednoho z mála správců, kteří si celou cestu prošli s daty v ruce.